Последнее странное, но увлекательное творение OpenAI – это DALL-E, которое в кратком изложении можно было бы назвать «GPT-3 для изображений». Он создает иллюстрации, фотоснимки, рендеры или любой другой метод, который вы предпочитаете, всего, что вы можете внятно описать, от «кота в галстуке-бабочке» до «редиса дайкона в пачке, выгуливающего собаку». Но пока не пишите некрологи для стоковых фотографий и иллюстраций.

Как обычно, OpenAI Описание его изобретения вполне читабельно и не слишком технически. Но это требует некоторого контекстуализации.

То, что исследователи создали с помощью GPT-3, было ИИ, который, получив подсказку, попытался бы создать правдоподобную версию того, что он описывает. Итак, если вы скажете «историю о ребенке, который нашел ведьму в лесу», он попытается написать ее – и если вы снова нажмете кнопку, он напишет ее снова, по-другому. И снова, и снова, и снова.

Некоторые из этих попыток будут лучше, чем другие; действительно, некоторые из них будут едва связными, в то время как другие могут быть почти неотличимы от того, что написано человеком. Но он не выводит мусор или серьезные грамматические ошибки, что делает его пригодным для множества задач, которыми сейчас занимаются стартапы и исследователи.

DALL-E (комбинация Dali и WALL-E) развивает эту концепцию еще дальше. Агенты ИИ уже много лет преобразуют текст в изображения с переменным, но неуклонно растущим успехом. В этом случае агент использует понимание языка и контекст, предоставляемые GPT-3 и его базовой структурой, для создания правдоподобного изображения, соответствующего приглашению.

Как говорит OpenAI:

GPT-3 показал, что язык может использоваться для указания большой нейронной сети выполнять различные задачи генерации текста. Image GPT показал, что тот же тип нейронной сети также может использоваться для создания изображений с высокой точностью. Мы расширяем эти результаты, чтобы показать, что манипулирование визуальными концепциями с помощью языка теперь доступно.

Они означают, что генератором изображений этого типа можно управлять естественным образом, просто говоря ему, что делать. Конечно, вы можете покопаться в его внутренностях и найти маркер, который представляет цвет, и расшифровать его пути, чтобы вы могли активировать и изменять их, как вы могли бы стимулировать нейроны реального мозга. Но вы не сделаете этого, когда попросите своего штатного иллюстратора сделать что-то синее, а не зеленое. Вы просто говорите «синяя машина» вместо «зеленая машина», и они получают это.

Так обстоит дело с DALL-E, который понимает эти подсказки и редко терпит неудачу, хотя нужно сказать, что даже если посмотреть на лучшую из сотни или тысячи попыток, многие изображения, которые он генерирует, больше, чем немного … выкл. Из которых позже.

В сообщении OpenAI исследователи приводят множество интерактивных примеров того, как можно сказать системе сделать небольшие вариации одной и той же идеи, и результат будет правдоподобным и часто довольно хорошим. Истина в том, что эти системы могут быть очень хрупкими, поскольку они признают, что DALL-E в некотором роде является уязвимым, и фраза «зеленый кожаный кошелек в форме пятиугольника» может дать то, что ожидается, но «синий замшевый кошелек в форме пятиугольника» может дать кошмарное топливо. Почему? Трудно сказать, учитывая черную природу этих систем.

Но DALL-E замечательно устойчив к таким изменениям и надежно производит практически все, что вы просите. Тор из гуакамоле, сфера из зебры; большой синий блок, сидящий на маленьком красном блоке; вид спереди счастливой капибары, изометрический вид грустной капибары; и так далее и тому подобное. Вы можете поиграть со всеми примерами в посте.

Он также демонстрировал непреднамеренное, но полезное поведение, используя интуитивную логику для понимания запросов, таких как просьба сделать несколько эскизов одного и того же (несуществующего) кота, с оригиналом вверху и эскизом внизу. Здесь нет специального кодирования: «Мы не ожидали появления этой возможности и не внесли никаких изменений в нейронную сеть или процедуру обучения, чтобы стимулировать ее». Это хорошо.

Интересно, что еще одна новая система от OpenAI, CLIP, использовалась вместе с DALL-E для понимания и ранжирования рассматриваемых изображений, хотя она немного более техническая и трудная для понимания. Вы можете прочитать о CLIP здесь.

Последствия этой возможности многочисленны и разнообразны, поэтому я не буду пытаться вдаваться в них здесь. Даже панты OpenAI:

В будущем мы планируем проанализировать, как модели, подобные DALL · E, связаны с социальными проблемами, такими как экономическое влияние на определенные рабочие процессы и профессии, возможность предвзятости в результатах модели и долгосрочные этические проблемы, связанные с этой технологией.

Прямо сейчас, как и GPT-3, эта технология потрясающая, но в отношении нее трудно делать четкие прогнозы.

Примечательно, что очень мало из того, что он производит, кажется действительно «окончательным» – то есть я не мог сказать ему, чтобы он создавал образ для всего, что я написал за последнее время, и ожидать, что он выпустит что-то, что я мог бы использовать без изменений. Даже краткий осмотр выявляет всевозможные странности ИИ (специализация Джанель Шейн), и хотя эти острые углы, безусловно, будут устранены со временем, это далеко небезопасно, т.к. текст GPT-3 не может быть отправлен без редактирования на месте человеческого письма.

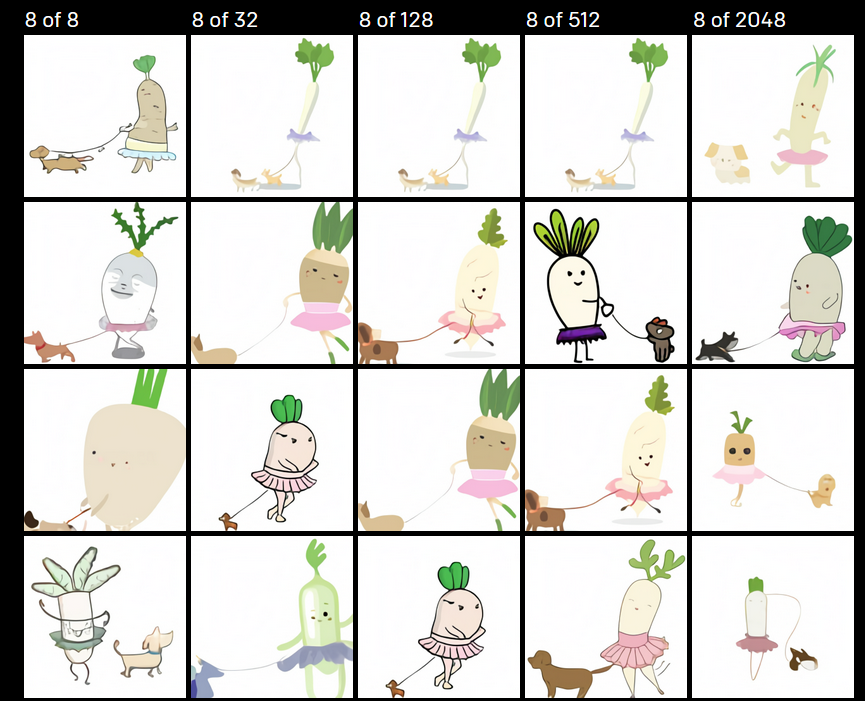

Как показано в следующей подборке, это помогает создать много и выбрать несколько лучших:

Сгенерированы 8 лучших из X, причем X увеличивается вправо.

Это не умаляет достижений OpenAI здесь. Это сказочно интересная и мощная работа, и, как и другие проекты компании, она, несомненно, вскоре перерастет во что-то еще более сказочное и интересное.