Поскольку будущее владения ByteDance на TikTok по-прежнему определяется между техническими левиафанами, инвесторами и правительственными чиновниками в конференц-залах, видео-приложение сегодня опубликовало свой последний отчет о прозрачности. Всего было удалено более 104,5 миллиона видеороликов; у него было почти 1800 юридических запросов; и получил 10 600 уведомлений о нарушении авторских прав за первую половину этого года. Наряду с этим, возможно, чтобы компенсировать большое количество незаконных видео, TikTok также объявил о новой инициативе – возможно, в партнерстве с другими социальными приложениями – против вредоносного контента.

Цифры в отчете о прозрачности подчеркивают вторую сюжетную линию о популярном приложении: правительство может захотеть закрыть TikTok из соображений национальной безопасности (если ByteDance не найдет новую некитайскую контролирующую структуру, которая удовлетворит законодателей). Но фактически, как и другие приложения для социальных сетей, у TikTok есть еще один немаловажный огонь, который нужно бороться: он борется с большим количеством незаконного и вредоносного контента, публикуемого и распространяемого на его платформе, и по мере того, как он продолжает расти в популярности (сейчас он имеет более 700 миллионов пользователей по всему миру), эта проблема также будет расти.

TikTok сообщил, что 104543719 видео, которые TikTok удалили во всем мире за нарушение принципов сообщества или его условий, услуга составлена менее 1% всех видео, загруженных в TikTok, что дает вам некоторое представление о масштабах сервиса.

ТИК Так заявили, что 96,4% от общего числа были удалены до того, как о них было сообщено, а 90,3% были удалены до того, как они получили какие-либо просмотры. В нем не указывается, были ли они обнаружены с помощью автоматизированных систем или модераторами-людьми, или их комбинацией, но похоже, что он переключился на модерацию на основе алгоритмов, по крайней мере, на некоторых рынках:

«В результате эпидемии COVID-19 мы больше полагались на технологии для обнаружения и автоматического удаления нарушающего контента на таких рынках, как Индия, Бразилия и Пакистан», – отметили в нем.

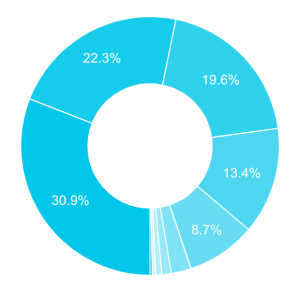

Компания отмечает, что самая большая категория удаленных видео связана с обнажением взрослых и сексуальными действиями – 30,9%, незначительная безопасность – 22,3% и незаконная деятельность – 19,6%. Другие категории включали самоубийства и членовредительства, материалы с насилием, язык вражды и опасные личности. (И видео можно было засчитывать более чем в одной категории, отметили в нем.)

Самый большой рынок для удаленных видео – это тот, на котором TikTok был запрещен (что неудивительно): львиная доля видео у Индии составила 37 682 924 человека. С другой стороны, на США пришлось 9822996 (9,4%) удаленных видео, что делает их вторым по величине рынком.

В настоящее время кажется, что дезинформация и дезинформация не являются основными способами злоупотребления TikTok, но они по-прежнему значительны: около 41820 видео (менее 0,5% от тех, которые были удалены в США) нарушают политику дезинформации и дезинформации TikTok, сообщает компания. сказал.

Около 321 786 видео (около 3,3% удаленного контента в США) нарушают его политику в отношении языка вражды.

По его словам, количество юридических запросов растет: за первые шесть месяцев года 1768 запросов на информацию о пользователях из 42 стран / рынков, из которых 290 (16,4%) поступают от правоохранительных органов США, включая 126 повесток в суд, 90 запросов ордера и 6 постановлений суда. Всего было получено 135 запросов от государственных органов на ограничение или удаление контента из 15 стран / рынков.

TikTok сообщил, что коалиция вредоносного контента основана на предложении, которое Ванесса Паппас, исполняющая обязанности главы TikTok в США, разослала девяти руководителям других социальных сетей. Он не указывает, какой и какой был ответ. Мы спрашиваем и будем обновлять, когда узнаем больше.

Предложение коалиции социальных сетей

Между тем, письмо, полностью опубликованное TikTok и перепечатанное ниже, подчеркивает ответ на текущие размышления о том, насколько активные и успешные платформы социальных сетей пытались пресечь некоторые злоупотребления своими платформами. Это не первая попытка такого рода – было несколько других попыток, подобных этой, когда несколько компаний, бывших конкурентов по привлечению потребителей, объединились единым фронтом для борьбы с такими вещами, как дезинформация.

Этот, в частности, определяет неполитический контент и предлагает «совместный подход к раннему выявлению и уведомлению участников индустрии о чрезвычайно жестоком графическом контенте, включая самоубийства». Меморандум о взаимопонимании, предложенный Паппасом, предполагал, что платформы социальных сетей взаимодействуют друг с другом, чтобы информировать друг друга о контенте – разумный шаг, учитывая, сколько информации распространяется на нескольких платформах с других платформ.

Усилия компании по созданию коалиции вредоносного контента – еще один пример того, как компании, работающие в социальных сетях, пытаются проявить собственную инициативу и показать, что они пытаются нести ответственность, что является ключевым способом лоббирования правительств, чтобы они не регулировали их. С Facebook, Twitter, YouTube а другие по-прежнему не в восторге от контента, которым делятся на их платформах – несмотря на их попытки обуздать злоупотребления и манипуляции – маловероятно, что это будет последнее слово по любому из этих вопросов.

Полный текст ниже:

В последнее время социальные и контентные платформы снова столкнулись с проблемой публикации и перекрестного размещения материалов о самоубийствах, которые затронули всех нас, а также наши команды, пользователей и более широкие сообщества.

Как и каждый из вас, мы усердно работали над предотвращением его распространения, удаляя исходный контент и его многочисленные варианты, а также ограничивая его просмотр или распространение другими. Однако мы считаем, что каждое из наших индивидуальных усилий по защите наших собственных пользователей и коллективного сообщества будет значительно усилено за счет формального совместного подхода к раннему выявлению и уведомлению участников отрасли о чрезвычайно жестоком графическом контенте, включая самоубийства.

С этой целью мы хотели бы предложить совместную разработку Меморандума о взаимопонимании (MOU), который позволит нам быстро уведомлять друг друга о таком содержании.

Отдельно мы проводим тщательный анализ событий, поскольку они связаны с недавним обменом контентом о самоубийствах, но очевидно, что раннее выявление позволяет платформам более быстро реагировать для подавления крайне нежелательных материалов с насилием.

Мы осознаем необходимость того, чтобы любое такое согласованное соглашение было четко определено в отношении типов контента, которое оно могло бы захватить, и было достаточно проворным, чтобы каждый из нас мог быстро перемещаться, чтобы уведомить друг друга о том, что будет зафиксировано в МоВ. Мы также понимаем, что в регионах могут существовать нормативные ограничения, которые требуют дальнейшего участия и рассмотрения.

С этой целью мы хотели бы созвать собрание наших соответствующих групп доверия и безопасности для дальнейшего обсуждения такого механизма, который, как мы считаем, поможет нам всем повысить безопасность наших пользователей.

Мы с нетерпением ждем вашего положительного ответа и совместной работы, чтобы помочь защитить наших пользователей и более широкое сообщество.

С уважением,

Ванесса Паппас

Глава Тик Ток

Еще не все.