Facebook может перенастроить свои алгоритмы ленты новостей. После того, как законодатели спросили законодателей о роли, которую Facebook сыграл в атаке на Капитолий США, компания объявила сегодня утром, что будет развертывать серию рейтинговых тестов News Feed, которые попросят пользователей предоставить отзывы о сообщениях, которые они видят. , который позже будет включен в процесс ранжирования ленты новостей Facebook. В частности, Facebook будет стремиться узнать, какой контент люди находят вдохновляющим, какой контент они хотят видеть меньше (например, политика), а также какие другие темы их обычно интересуют, среди прочего.

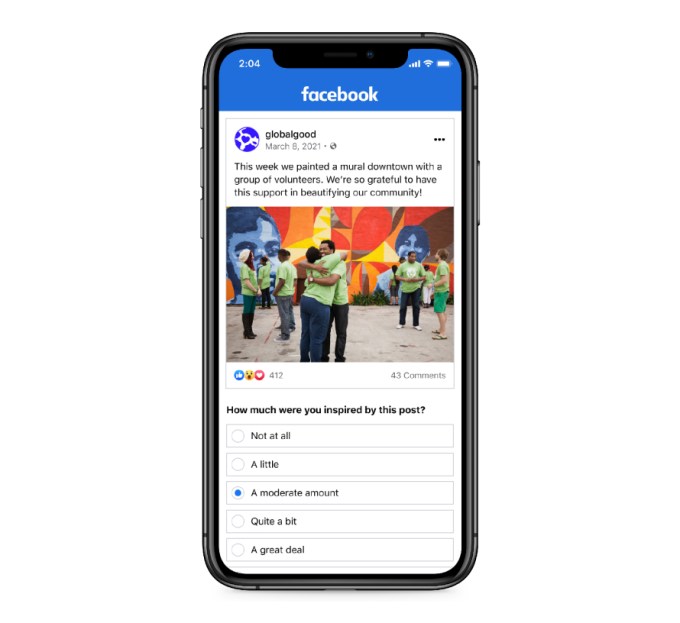

Это будет сделано с помощью серии глобальных тестов, один из которых будет включать в себя опрос непосредственно под самой публикацией, в котором спрашивается: «Насколько вас вдохновил этот пост?», С целью помочь показать большему количеству людей сообщения о публикации. воодушевляющая натура ближе вверху ленты новостей.

Кредиты изображений: Facebook

Другой тест будет работать с новостной лентой Facebook, чтобы отразить то, что люди хотят видеть. Сегодня Facebook уделяет первоочередное внимание показу контента из друзей, групп и страниц, на которые вы хотите подписаться, но он алгоритмически определил, чьи сообщения показывать вам и когда, на основе различных сигналов. Это включает в себя как неявные, так и явные сигналы – например, насколько активно вы взаимодействуете с контентом этого человека (или страницей или группой) на регулярной основе, а также добавили ли вы их в качестве «близких друзей» или «избранных», указывая, что вы хотите например, чтобы увидеть больше их контента, чем другие.

Однако то, что вы близки с кем-то в реальной жизни, не означает, что вам нравится то, что они публикуют в Facebook. Это разлучило семьи и друзей в последние годы, поскольку люди через социальные сети узнали, как люди, которых, как они думали, они знали, на самом деле смотрят на мир. Для некоторых это была болезненная расплата. Facebook тоже не удалось решить проблему. Сегодня пользователи по-прежнему прокручивают новостные ленты, укрепляющие их взгляды, какими бы проблемными они ни были. А с нарастающей волной дезинформации, лента новостей превратилась из простого помещения пользователей в пузырек фильтров и превратилась для некоторых в полную альтернативную реальность, часто населенную теориями заговора.

Третий тест Facebook не обязательно решает эту проблему напрямую, но вместо этого пытается получить обратную связь о том, что пользователи хотят видеть в целом. Facebook сообщает, что начнет спрашивать людей, хотят ли они видеть больше или меньше сообщений на определенные темы, такие как кулинария, спорт, политика и т. Д. Основываясь на коллективных отзывах пользователей, Facebook скорректирует свои алгоритмы, чтобы показывать больше контента, который люди говорят, что они им интересны, и меньше сообщений на темы, которые они не хотят видеть.

В частности, сфера политики была проблемой для Facebook. Социальная сеть в течение многих лет была призвана способствовать разжиганию политического дискурса, поляризации и радикализации пользователей с помощью своих алгоритмов, масштабному распространению дезинформации и поощрению экосистемы вызывающих разногласия кликбейтов, поскольку издатели стремились к вовлечению, а не к справедливости и равновесию при составлении отчетов. Новости. В настоящее время существуют полностью предвзятые и субъективные СМИ, выдающие себя за источники новостей, которые фактически извлекают выгоду из таких алгоритмов, как Facebook.

Вскоре после атаки на Капитолий Facebook объявил, что попытается ограничить политический контент в новостной ленте для небольшого процента людей в США, Канаде, Бразилии и Индонезии на период времени во время тестов.

Теперь компания заявляет, что будет работать, чтобы лучше понять, с каким контентом связаны негативные впечатления от новостной ленты, включая политический контент. В этом случае Facebook может спросить пользователей в сообщениях с большим количеством негативных реакций, какой контент они хотят видеть меньше.

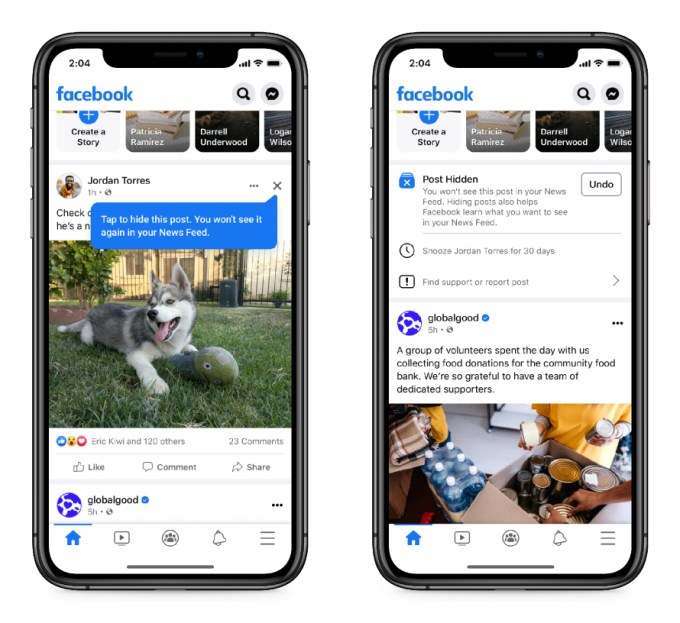

В нем также будет более заметна возможность скрывать сообщения, которые вы считаете «нерелевантными, проблемными или раздражающими». Хотя эта функция существовала раньше, теперь вы можете нажать X в правом верхнем углу сообщения, чтобы скрыть его из ленты новостей, если он находится в тестовой группе, и видеть меньше, чем в будущем, для большего индивидуальный опыт.

Неясно, позволяет ли пользователям выбирать свои темы – лучший способ решить более серьезные проблемы, связанные с негативными сообщениями, вызывающим разногласия или дезинформацией, хотя этот тест не столько касается последних, а больше – того, чтобы «чувствовать» новостную ленту более позитивно. .

Поскольку данные собираются в результате тестов, Facebook будет включать полученные знания в свои алгоритмы ранжирования ленты новостей. Но неясно, в какой степени он будет настраивать алгоритм на глобальной основе по сравнению с простой настройкой опыта для конечных пользователей на более индивидуальной основе с течением времени.

Компания заявляет, что испытания продлятся в течение следующих нескольких месяцев.